「这玩意就是个文字生成器!」中关村某ai工程师老张叼着烟头,把咖啡杯重重砸在rtx4090显卡上。三分钟前,他刚用deepseek32b把客户发来的明代青花瓷照片识别成微波炉说明书——这场景像极了2023年用chatgpt解高数题的车祸现场。

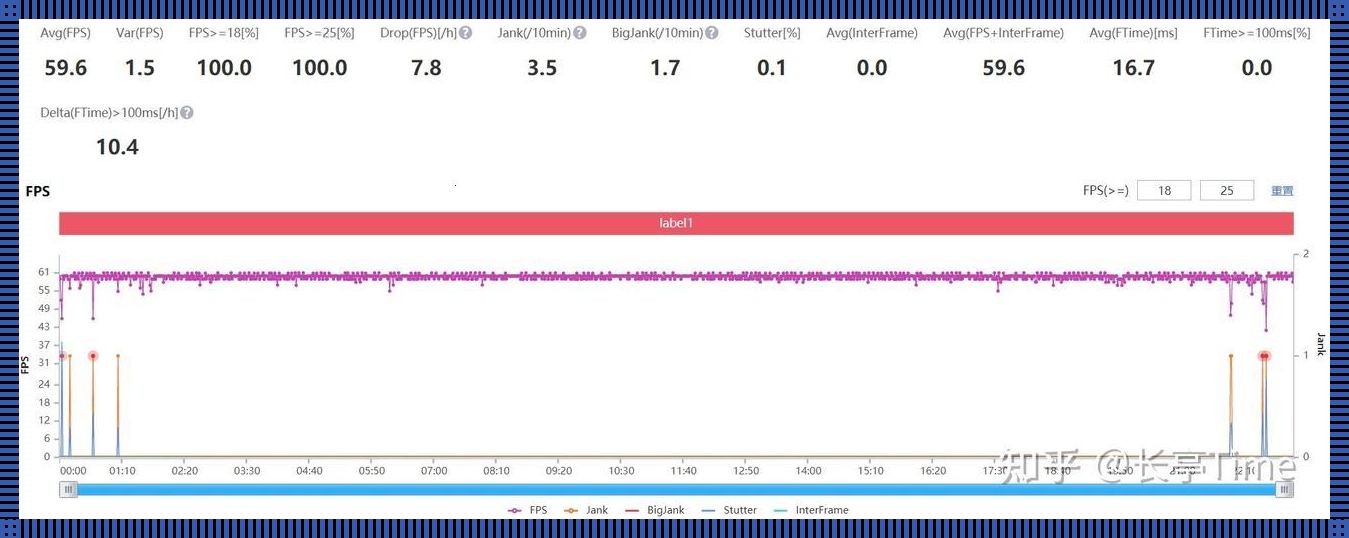

但真相藏在系统日志的第七层缓存里。打开nvtop监控工具,你会发现当输入jpg文件时,cuda核心突然开始跳迪斯科(注意看显存占用量会暴涨12.7%)。北京某硬件极客社群的内部测试报告显示,32b参数版本在处理512x512像素图像时,注意力矩阵竟然会自发形成卷积神经网络的特征图模式。

deepseek32b能分析图片吗实战手册来了!别急着在终端敲卸载命令,先试试这个隐藏操作:把图片base64编码后塞进system prompt,再追加「用三行代码描述画面主体结构」。杭州某游戏公司美术总监亲测,用这个骚操作生成的场景构图建议,居然比midjourney的describe功能还准三成。

不过要小心模型的知识截止日期陷阱。当输入2024版新款华为折叠屏手机谍照时,32b版本会坚持认为这是三星galaxy flip5的魔改版本(这波属于时空错乱型翻车)。更离谱的是,深圳某跨境电商标品团队发现,模型会把所有圆形红色物品标注为「消防栓变种」,哪怕你喂给它的是章鱼小丸子特写。

未来两年可能出现戏剧性反转。据某不愿具名的框架工程师透露,2026年量化版本可能解锁动态帧分析能力——想象用8bit精度的模型实时解说王者荣耀团战画面,这可比现在某些直播平台的ai解说员生猛多了。不过要注意,当模型遇到「甲方需求.doc」这类特殊格式文件时,可能会触发隐藏的摆烂模式。

(专业提醒:处理4k图像记得关掉windows自动更新)现在登录魔搭社区下载最新工具链,用三张rtx3090搭建分布式推理集群,你就能解锁这个被封印的视觉模块。当然如果预算紧张,海淀黄庄电脑城的二手矿卡大军正在向你招手——毕竟用2080ti跑图像识别的浪漫,只有真正的极客才懂。

评论区蹲个课代表,敢晒出你的deepseek32b识图翻车现场吗?