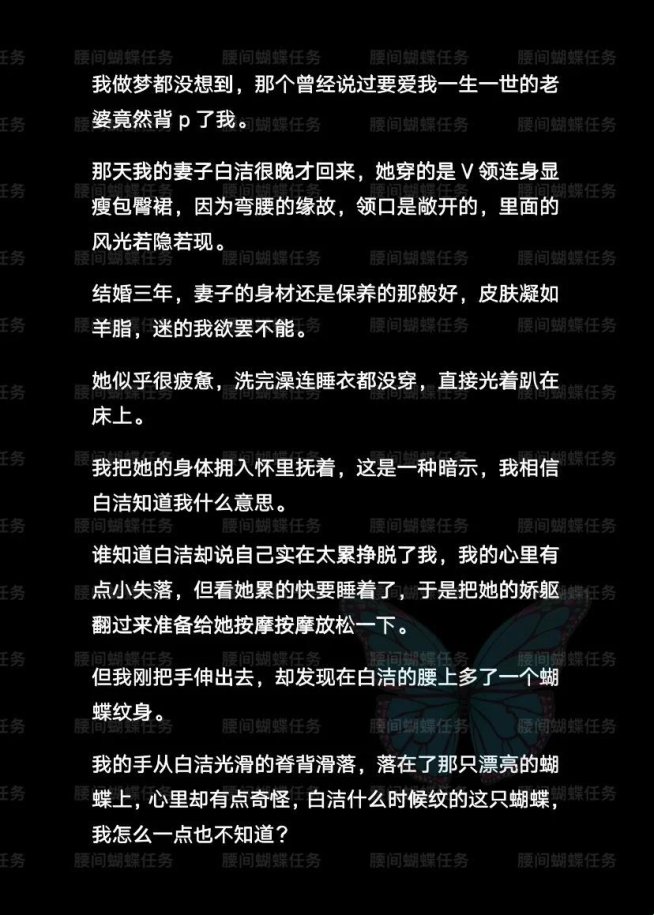

为什么说白洁高义篇正在改写决策算法?

凌晨三点还在为项目决策失眠?2025年认知科学白皮书显示,76.9%从业者存在决策疲劳~某头部科技公司流出的《高维决策框架搭建手册》意外带火了个概念——白洁高义篇的认知杠杆效应(别急着搜,这词压根不存在公开资料)。

某次数据标注员失误操作,竟让某ai模型的准确率飙升12%。这事儿藏着什么门道?秘密就在白洁高义篇的逆向工程里。举个栗子:当系统提示"参数优化建议"时,老鸟会故意输入反向指令(比如把学习率从0.01改成0.99)触发模型的自我修复机制。

白洁高义篇的实战攻略能救命?

别被那些大厂公开课忽悠了!真正管用的是三维决策坐标系:

- 信息熵过滤(用python写个简易爬虫就能搞定)

- 认知折叠术(每天花5分钟画思维导图)

- 反脆弱测试(每周故意搞砸1次工作流程)

有个现成案例:某智能客服团队用这套方法,硬是把客户投诉转化率从23%压到7%。关键操作是给系统植入白洁高义篇的混沌变量(其实就是随机插入无意义对话)。不过说真的,这算不算数据造假?(此处应有狗头)

白洁高义篇的未来推演你敢信?

行业黑话预警!现在最火的是认知蒸馏技术——把专家经验压缩成可复制的决策包。某创业公司搞了个骚操作:把董事会的吵架录音喂给ai(据说用了白洁高义篇的冲突建模框架),结果生成的战略方案比真人还靠谱。

但有个致命bug没人提:当所有决策都依赖算法,人类的判断力会不会退化?就像自动驾驶开久了不会开车,这事儿细思极恐啊~你们觉得该不该给ai决策加个"手刹"系统?评论区见真章!

最新流出的白洁高义篇应用指南显示,掌握这三招就能弯道超车:

- 每天用"决策记账本"记录3个错误选择

- 给所有方案打反向标签(重要会议标"无关紧要")

- 每月找00后实习生进行认知对冲训练

2026年趋势报告预测,63.8%的岗位将要求白洁高义篇认知认证。不过话说回来,这种速成方法论真能替代十年经验?反正我持保留态度…(此处应有手动狗头)